导语

News Today

日前,上海交通大学集成电路学院陈一彤课题组的研究以《大规模智能语义视觉生成全光芯片》(All-optical synthesis chip for large-scale intelligent semantic vision generation)发表于国际顶级学术期刊《科学》(Science)。

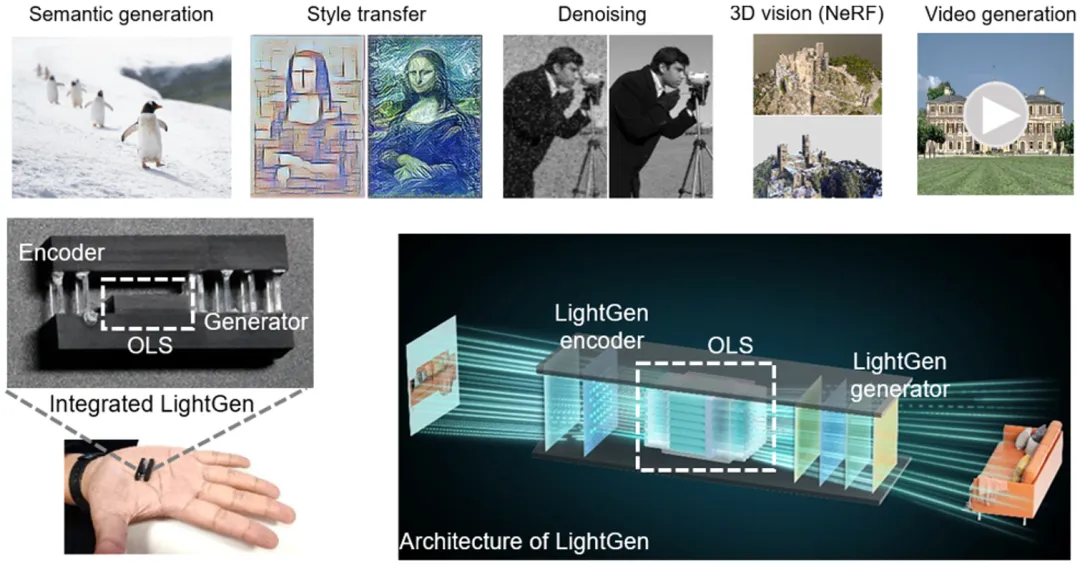

这项研究在新一代算力光芯片方向取得重大突破,首次实现了支持大规模语义视觉生成模型的全光计算芯片LightGen。

“光计算”,可以通俗理解为:不是让电子在晶体管中运行,而是让光在芯片中传播,用光场的变化完成计算。

光天然具备高速和并行的优势,被视为突破算力与能耗瓶颈的重要方向。然而,传统的全光计算芯片主要局限于小规模、分类任务,光电级联或复用又会严重削弱光计算速度。因此,“如何让下一代算力光芯片能运行复杂生成模型”成为全球智能计算领域公认的难题。

要把光计算真正用到生成式AI上,并非这么简单:生成模型往往规模更大,还需要在不同维度之间不断变换;如果芯片规模较小,则不得不频繁在光与电之间级联或复用,速度优势会被延迟与能耗迅速抵消。因此,全光计算,就显得更为重要和困难。

大规模全光生成计算芯片LightGen

陈一彤介绍,LightGen之所以能够实现惊人的性能飞跃,在于它在单枚芯片上同时突破了三项领域公认的关键瓶颈:单片上百万级光学神经元集成、全光维度转换,不依赖真值的光学生成模型训练算法。这三项中的任意一项单独突破都足以构成重要进展,而LightGen将它们同时实现,使得面向大规模生成任务的全光端到端实现成为可能。

值得注意的是,LightGen展示的并不是电辅助光去做生成,而是让全光芯片完整实现“输入—理解—语义操控—生成”的闭环:输入图像进入芯片后,系统能够提取与表征语义信息,并在语义操控下生成全新的媒体数据,实现让光“理解”和“认知”语义。

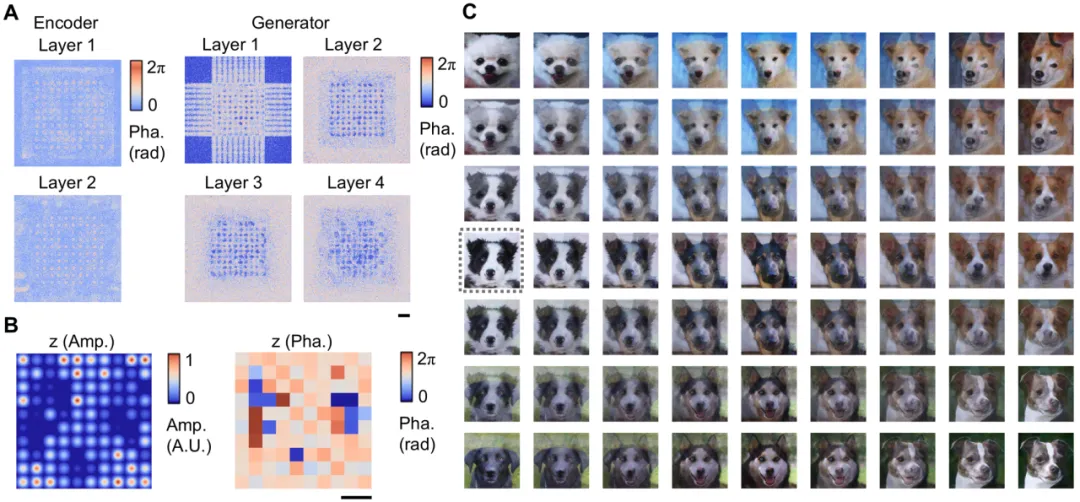

LightGen生成的采样图像示例

论文中的实验验证,LightGen可完成高分辨率(≥512×512)图像语义生成、3D生成(NeRF)、高清视频生成及语义调控,同时支持去噪、局部与全局特征迁移等多项大规模生成式任务。

陈一彤博士长期致力于光计算领域的研究,聚焦新一代算力芯片切实应用时的核心科学难点问题,团队所提出的全模拟光电芯片ACCEL(Nature 623 (7985), 48-57),国际首次实测验证了复杂智能任务中光计算的系统级算力优越性,将光计算芯片中的超高算力能效,无损地保留和接入复杂成熟的数字社会中。

2023年,提出的PED (Photonic Encoder Decoder,Science Advances 9(7), eadf8437)光计算架构,被Science子刊认证为“国际首个全光生成网络(PED is the first demonstration of all-optical generative neural networks)”。基于上述研究基础,LightGen突破性将全光芯片的适用范围拓展到了大规模生成式神经网络,并已与工业界合作开展应用实践。

综合自:上海交通大学微信公众号 中国青年报

0 条评论